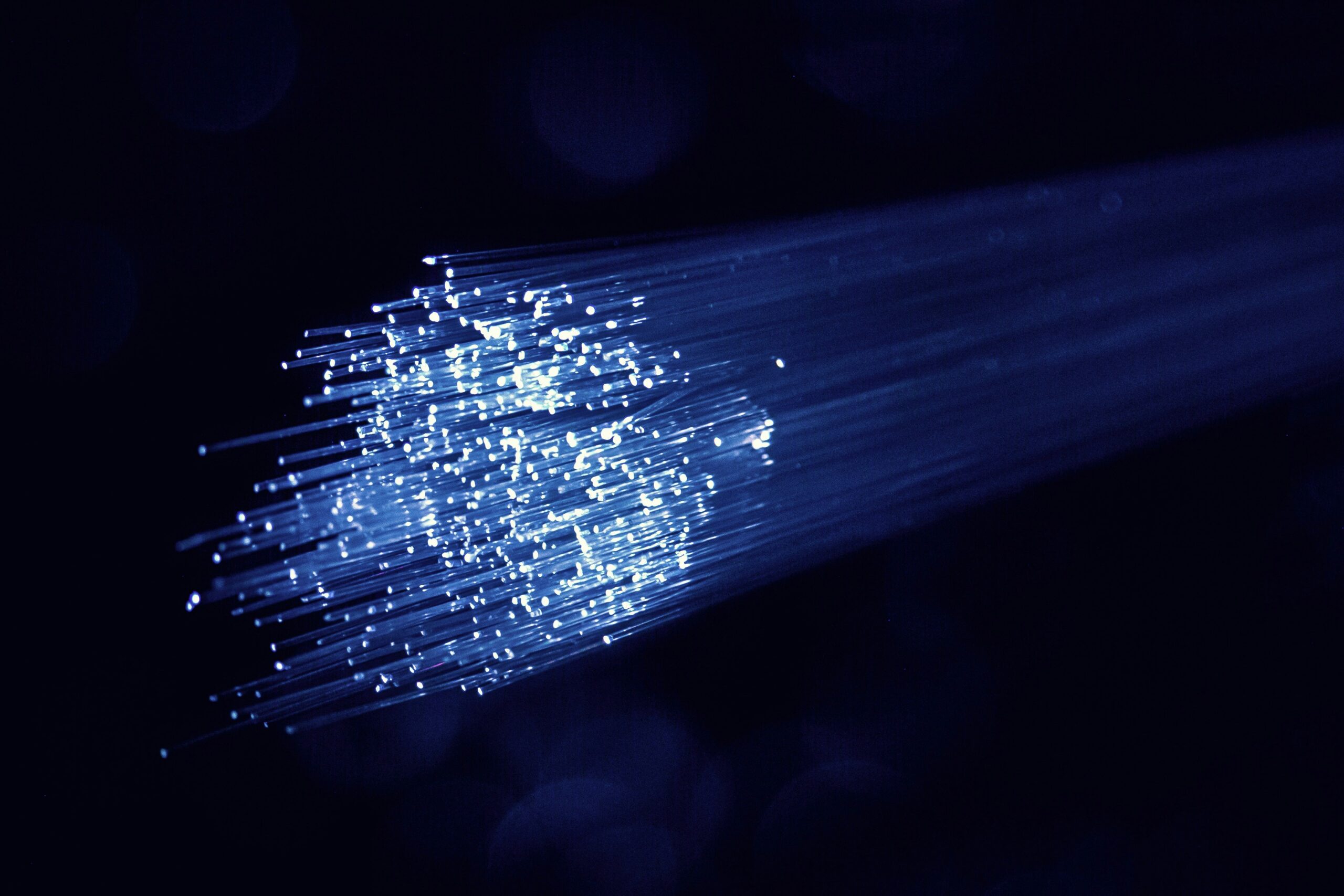

Dans un contexte où la transformation numérique s’accélère, la performance réseau devient le socle indispensable de la compétitivité des entreprises. Le SD-WAN (Software-Defined Wide Area Network) s’impose comme la solution incontournable pour répondre à cette exigence, en offrant une gestion optimisée, agile et sécurisée des infrastructures. Mais pour véritablement tirer parti de ses promesses, il est essentiel d’optimiser chaque facette du réseau, tout en assurant une souveraineté numérique qui protège les données sensibles face aux enjeux géopolitiques actuels. Par ailleurs, mesurer l’expertise IT et maîtriser les coûts sans compromis sur la qualité restent des priorités majeures pour les décideurs informatiques en quête d’excellence et de pérennité.

En effet, la gestion d’un réseau SD-WAN efficace ne se limite pas à l’activation d’une technologie : c’est un équilibre subtil entre performance, sécurité et économies, au cœur d’une stratégie digitale résolument orientée vers l’avenir. Il s’agit aussi de pouvoir piloter l’ensemble des flux avec souplesse, en s’appuyant sur des plateformes souveraines hébergées sur le territoire national, tout en bénéficiant d’un accompagnement expert capable d’exploiter pleinement les potentialités du SD-WAN, notamment grâce à la scalabilité offerte par les dernières innovations technologiques. Ce tissu harmonieux garantit une connectivité fiable et évolutive, indispensable pour les industriels, les services et les organisations publiques.

En bref :

- Le SD-WAN optimise la performance réseau en identifiant le meilleur chemin pour chaque flux en temps réel.

- La souveraineté numérique est assurée grâce à des plateformes hébergées en France, garantissant la confidentialité des données.

- Une gestion proactive et centralisée simplifie le pilotage des infrastructures réseau multi-sites.

- L’expertise IT et un accompagnement personnalisé facilitent l’adaptation et la montée en charge des solutions SD-WAN.

- La réduction des coûts s’appuie sur une utilisation intelligente de la bande passante et des stratégies de routage dynamiques.

- Les politiques d’optimisation QoS améliorent significativement l’expérience utilisateur et respectent les SLA.

Les clés de l’optimisation réseau dans un environnement SD-WAN moderne

L’optimisation réseau avec le SD-WAN est devenue une nécessité absolue face à la croissance exponentielle du volume de données et à la diversité croissante des applications métiers. Dans un monde où les collaborateurs utilisent simultanément des applications cloud privées, des SaaS tiers comme Microsoft 365 ou Salesforce, le réseau doit s’adapter en continu pour garantir une connectivité fluide et performante. Cette performance découle avant tout de la capacité à identifier, en temps réel, le chemin le plus efficace pour chaque type de trafic, qu’il s’agisse de vidéo en direct, de voix ou de données critiques.

Le SD-WAN repose sur une architecture intelligente, pilotée par un contrôleur central, capable de gérer plusieurs liens WAN, qu’il s’agisse de MPLS, d’Internet ou de 5G. Ce pilotage centralisé offre une visibilité consolidée et un contrôle renforcé. Chaque routeur en périphérie exécute les politiques déterminées par ce contrôleur, assurant la meilleure répartition de la bande passante selon la priorité des applications. Cette dynamique favorise une meilleure allocation des ressources et une réduction significative de la latence, pivot pour maintenir une qualité d’expérience irréprochable.

Par exemple, dans une grande entreprise multisite, les appels vidéo nécessitent nettement plus de bande passante et une latence très basse. Le SD-WAN détecte ce besoin et privilégie automatiquement le trajet le plus performant, évitant ainsi les interruptions ou décalages. Simultanément, les flux de données moins sensibles à la latence peuvent être acheminés via des connexions secondaires, moins coûteuses.

Cette approche est également soutenue par une supervision centralisée qui facilite la gestion réseau. Une interface unique permet de superviser et paramétrer en temps réel tous les accès, qu’ils proviennent du siège, des agences ou des succursales. La simplification ainsi obtenue réduit considérablement la charge opérationnelle et limite les erreurs humaines, contribuant à une meilleure productivité globale de l’entreprise.

La sécurisation des échanges est aussi un pilier fondamental. En combinant SD-WAN et solutions de cybersécurité avancées telles que des firewalls intégrés, chaque flux est filtré et protégé, aussi bien sur le WAN que sur le LAN, garantissant la continuité des opérations et la confidentialité des données sensibles face aux menaces externes.

Pour aller plus loin dans cette démarche, les entreprises disposent aujourd’hui de ressources précieuses en accompagnement et expertise. L’appui de spécialistes dans la transformation réseau permet d’affiner les configurations, d’assurer la montée en charge et d’adapter constamment la plateforme aux évolutions métiers et technologiques. Ce support actif s’inscrit dans une dynamique collaborative, favorisant le partage d’expériences et la co-construction de meilleures pratiques autour du SD-WAN.

Ces pratiques sont essentielles face à des applications aux exigences très diverses, situation que beaucoup d’entreprises rencontrent en modernisant leur infrastructure réseau, rendant indispensable une gestion fine et dynamique du trafic. L’optimisation réseau dans le cadre d’un SD-WAN maîtrisé relève donc d’une stratégie holistique intégrant technologie, accompagnement et sécurité.

Garantir la souveraineté numérique grâce à des infrastructures SD-WAN hébergées en France

La souveraineté numérique est aujourd’hui un enjeu stratégique majeur. Dans un contexte international marqué par des risques croissants de cyberespionnage et de fuite de données, la localisation des infrastructures réseau constitue une garantie fondamentale pour les entreprises soucieuses de préserver la confidentialité de leurs informations sensibles.

Le recours à des plateformes hébergées dans des datacenters français, comme ceux de Cyllene, offre une triple assurance : sécurisation des données selon des standards stricts, conformité réglementaire avec le RGPD, et indépendance face à la juridiction extraterritoriale. Cette approche empêche l’accès non autorisé des géants technologiques étrangers et renforce la confiance dans la chaîne digitale.

En parallèle, l’architecture proposée s’appuie sur des infrastructures hyperperformantes, notamment avec l’intégration de technologies comme Nvidia H200. Cette dernière garantit une puissance de traitement exceptionnelle, une scalabilité horizontale et verticale quasi illimitée, offrant la capacité d’adapter rapidement la plateforme SD-WAN aux besoins en constante évolution des entreprises, tout en maintenant une maîtrise complète des données.

L’importance de cette souveraineté s’étend bien au-delà de la simple sécurité. Elle influe très directement sur la performance globale du réseau. Héberger les contrôleurs et les outils de gestion en local élimine les latences additionnelles souvent générées par des échanges transfrontaliers. C’est un atout déterminant dans la quête d’une optimisation réseau réussie.

Par ailleurs, cette localisation permet un accès rapide et privilégié à des équipes d’experts locaux dédiés à la gestion réseau. Ce lien humain et technique est un facteur différenciant important pour résoudre rapidement incidents et ajustements opérationnels, consolidant ainsi la résilience du système dans son ensemble.

Enfin, les stratégies de sécurisation complémentaires proposées par ces infrastructures souveraines s’intègrent parfaitement à la politique globale de cybersécurité des entreprises. Cette synergie entre performance, souveraineté et sécurité crée un environnement propice à l’innovation, où la confiance est à la base des transformations numériques.

Pour un aperçu complet des bénéfices, il est utile de se référer aux nombreux retours d’expérience disponibles chez les leaders qui militent pour un SD-WAN souverain et performant, comme exposé dans certains blogs spécialisés.

Les avantages d’un hébergement souverain

- Protection accrue des données sensibles, en évitant le risque d’interception par des acteurs étrangers.

- Conformité stricte aux règles européennes et françaises en matière de protection des données.

- Réduction de la latence grâce à un hébergement local pour un accès rapide aux contrôleurs SD-WAN.

- Support technique réactif avec des équipes experts et proches géographiquement.

Stratégies d’expertise IT pour maîtriser la gestion et la performance SD-WAN

La mise en œuvre optimale d’un réseau SD-WAN réclame un niveau d’expertise IT avancé. Cette compétence doit couvrir non seulement les aspects techniques de configuration, mais aussi la compréhension approfondie des enjeux métiers et des flux applicatifs. L’expérience montre que le succès dépend largement de l’approche intégrée entre innovation technologique et pilotage humain éclairé.

Un des aspects cruciaux est la mise en place d’un système d’optimisation QoS (Quality of Service) efficace. Ce dernier permet d’allouer dynamiquement la bande passante selon la criticité des applications, garantissant ainsi une performance optimale aux usages prioritaires tout en assurant une gestion équitable des ressources.

La nouveauté réside aussi dans l’utilisation d’algorithmes avancés basés sur la collecte et l’analyse en temps réel des indicateurs réseau (latence, pertes de paquets, trafic croisé). Cette méthode évite l’envoi de sondes supplémentaires qui alourdiraient inutilement le trafic. Les décisions sont prises via une architecture de plan de contrôle centralisé ou distribué, rendant la gestion adaptable et évolutive.

Par exemple, dans un cas pratique, un contrôleur SD-WAN peut ajuster instantanément la répartition de la bande passante entre un outil CRM intensif et une application de communication interne, améliorant à la fois la réactivité et la fluidité opérationnelle. Cette souplesse permet aussi de mieux respecter les accords de niveau de service (SLA), un impératif pour les directions informatiques.

L’expertise IT ne se limite pas à la technologie. Elle inclut un accompagnement permanent des équipes métier pour explorer de nouveaux cas d’usage, optimiser les politiques de sécurité, et anticiper les évolutions. Ce lien fort entre compétence et pilotage stratégique contribue à pérenniser la qualité et la performance du réseau.

Une ressource précieuse à considérer est le cadre de réflexion collaborative proposé par certaines structures, comme un « think tank » dédié à l’expérimentation et au partage autour du SD-WAN, favorisant une innovation continue en matière d’infrastructure réseau.

Les bonnes pratiques pour garantir la performance et la fiabilité d’un SD-WAN bien piloté sont détaillées dans plusieurs guides reconnus, notamment dans cette expertise dédiée.

Liste des piliers pour une expertise IT réussie en SD-WAN :

- Formation continue des équipes sur les technologies émergentes et les protocoles réseau.

- Collecte et analyse proactive des métriques réseau pour un ajustement dynamique des politiques.

- Intégration de la sécurité dès la conception, en collaboration étroite avec les équipes cybersécurité.

- Déploiement progressif et tests réguliers pour valider les configurations avant industrialisation.

- Partage d’expériences et collaboration avec des partenaires spécialisés et des communautés professionnelles.

Réduction des coûts par une gestion intelligente et évolutive du SD-WAN

Le modèle SD-WAN bouleverse également les paradigmes traditionnels de gestion des infrastructures réseau, en introduisant une flexibilité accrue dans la gestion de la bande passante et des ressources. L’enjeu stratégique : améliorer la performance réseau tout en réduisant les dépenses opérationnelles et d’investissement.

La capacité à combiner plusieurs types de connexions – fibre, 4G/5G, MPLS – permet de tirer profit des offres les plus économiques sans sacrifier la qualité. La redistribution dynamique du trafic, portée par des algorithmes d’optimisation QoS sophistiqués, assure que les applications essentielles bénéficient des ressources critiques quand elles en ont besoin, et que les usages moins priorisés exploitent les liens de moindre coût.

Un exemple concret est celui d’une entreprise multi-sites qui, avant SD-WAN, utilisait majoritairement une connexion MPLS onéreuse sur tous ses liens. Grâce au SD-WAN, elle peut basculer certains flux vers de l’Internet haut débit moins coûteux, tout en conservant la performance via une gestion intelligente et centralisée. Ce basculement engendre une baisse significative des coûts sans affecter la qualité des services.

De plus, la simplification de la gestion réseau réduit la dépendance à des équipes pléthoriques dédiées à la maintenance et aux interventions techniques, amortissant ainsi les dépenses sur le long terme. Cette optimisation contribuant à une meilleure allocation budgétaire, les entreprises peuvent réinvestir dans des projets d’innovation et de transformation digitale.

Voici un tableau illustrant l’impact économique de la migration vers un SD-WAN performant :

| Poste de dépense | Avant SD-WAN | Après SD-WAN | Économie estimée |

|---|---|---|---|

| Coûts de connectivité (MPLS, 4G/5G, Internet) | 100 000 € | 60 000 € | 40% |

| Maintenance réseau | 40 000 € | 25 000 € | 37,5% |

| Support technique | 30 000 € | 20 000 € | 33% |

| Investissements infogérance | 20 000 € | 15 000 € | 25% |

La gestion intelligente offerte par le SD-WAN favorise donc une distribution optimisée des ressources tout en assurant la maîtrise des dépenses, clé d’une stratégie réseau pérenne et efficace. Les économies réalisées peuvent être substantielles, à condition que la solution soit bien configurée et accompagnée par une expertise reconnue, en adéquation avec les meilleures pratiques du marché.

Les entreprises souhaitant approfondir les stratégies d’optimisation financière peuvent se référer à des études de cas et conseils disponibles sur des plateformes expertes telles que ces solutions spécialisées.

Mesures avancées pour contrôler et améliorer en continu la performance réseau SD-WAN

Pour pérenniser la qualité et l’efficacité d’un réseau SD-WAN, il est indispensable d’assurer une surveillance fine et continue des indicateurs critiques. Plus qu’une simple collecte, ces mesures doivent permettre des ajustements en temps réel, garantissant un parcours utilisateur fluide et conforme aux niveaux de service attendus.

Les technologies actuelles s’appuient sur une architecture dite de plan de contrôle qui supervise chaque routeur périphérique et évalue en permanence la qualité des différentes liaisons disponibles : latence, perte des paquets, congestion et trafic croisé. Ces données alimentent des algorithmes qui ajustent automatiquement les politiques de routage et d’allocation de bande passante selon des priorités précises.

Cette intelligence réseau contribue directement à la réduction des incidents liés à la saturation ou aux défaillances imprévues. Par exemple, un routeur SD-WAN peut, en fonction des contraintes détectées, redistribuer instantanément le trafic vidéo vers des liens moins chargés, tout en maintenant les applications critiques à leur niveau de performance optimal.

Par ailleurs, cette approche contribue à renforcer la cybersécurité en évitant les comportements réseau anormaux liés à des attaques ou à des intrusions. La capacité à détecter rapidement ces anomalies permet de déclencher des procédures de protection sans impact significatif sur la qualité de service.

Les solutions d’optimisation et de supervision continue sont d’autant plus efficaces lorsqu’elles sont associées à un accompagnement expert. Cela permet non seulement de tirer parti des innovations technologiques, mais aussi d’affiner les configurations adaptées au contexte spécifique de chaque organisation. La démarche est d’autant plus pertinente qu’elle s’inscrit dans un cycle d’amélioration continue, indispensable dans le monde volatil et complexe des infrastructures réseau.

Pour une mise en œuvre exemplaire de ces dispositifs, les références et outils proposés par des spécialistes se révèlent particulièrement utiles, comme ceux détaillés dans ce guide métier sur la performance SD-WAN.

À l’horizon de cette évolution technologique, l’optimisation ne s’arrête pas à la simple gestion de la bande passante. Elle englobe aussi les protocoles de collaboration entre équipements, la prise en compte des spécificités métiers et la mise en place de solutions modulables et agiles face aux demandes fluctuantes.

Qu’est-ce que le SD-WAN et pourquoi est-il crucial pour les entreprises ?

Le SD-WAN est une technologie qui optimise et sécurise la gestion des réseaux étendus en utilisant une architecture logicielle. Il améliore la connectivité, facilite la gestion réseau multi-sites et augmente la performance tout en réduisant les coûts.

Comment la souveraineté numérique influence-t-elle la sécurité des réseaux SD-WAN ?

En hébergeant les infrastructures en France et sous juridiction nationale, la souveraineté numérique protège les données sensibles contre les intrusions étrangères et assure la conformité aux normes européennes, renforçant ainsi la cybersécurité globale.

Quelle est l’importance de l’optimisation QoS dans un réseau SD-WAN ?

L’optimisation QoS garantit que les applications critiques reçoivent une bande passante suffisante en priorité, tout en assurant une répartition équitable pour les autres flux ce qui maximise la performance et la qualité d’expérience utilisateur.

Quels sont les bénéfices financiers liés au déploiement d’un SD-WAN ?

Grâce à une gestion dynamique de la bande passante et à l’usage combiné de plusieurs types de liens moins coûteux, les entreprises réduisent significativement leurs dépenses en connectivité, maintenance et support, tout en améliorant leur efficacité opérationnelle.

Comment assurer une gestion efficace et évolutive d’un réseau SD-WAN ?

La clé réside dans une supervision continue, l’analyse en temps réel des indicateurs réseau et un accompagnement expert capable d’ajuster les politiques de routage et de sécurité en fonction des besoins métier et des variations du trafic.