Dans un paysage informatique en transformation permanente, Kubernetes occupe aujourd’hui une place majeure dans les discussions sur la modernisation des systèmes d’information. Pour autant, toutes les organisations ne l’ont pas encore adopté — et, dans bien des cas, cette situation découle d’un choix stratégique, d’une trajectoire maîtrisée ou d’une planification progressive de la modernisation.

Certaines DSI privilégient une montée en maturité graduelle : amélioration de l’usine logicielle, optimisation de la virtualisation, expérimentation des conteneurs, adoption de PaaS ou mise en place d’orchestrateurs légers. L’enjeu est de construire un chemin adapté au SI, cohérent avec les capacités internes, les besoins métiers et les objectifs de moyen terme.

Moderniser son système d’information sans le surcomplexifier est une préoccupation majeure pour de nombreuses équipes techniques. Les attentes sont fortes : automatisation, résilience, portabilité, maîtrise des coûts et rapidité de mise en production. Mais la méthodologie compte autant que l’outillage. Une modernisation réussie n’est pas seulement une question de technologie : c’est une trajectoire progressive, structurée et alignée avec la réalité opérationnelle.

Cet article propose un éclairage sur les voies de modernisation possibles pour les organisations qui souhaitent évoluer vers des pratiques cloud-native — à leur rythme, selon leur contexte — tout en préservant la maîtrise d’un SI souvent hétérogène et ancien.

Moderniser étape par étape : la conteneurisation comme fondation

La conteneurisation constitue souvent le premier levier pour amorcer la transformation du SI. Elle permet de gagner en homogénéité, en portabilité et en reproductibilité sans bouleverser les architectures existantes, tout en préparant une éventuelle adoption de kubernetes. Docker, et plus largement l’écosystème des conteneurs, offre un cadre pratique pour isoler les services, standardiser les environnements et faciliter les pipelines CI/CD.

Les bénéfices immédiats :

- Des environnements identiques du développement à la production.

- Une réduction des écarts de configuration et des risques d’erreur.

- Une simplification des déploiements et des mises à jour.

- Une base technique prête pour des évolutions ultérieures.

Pour de nombreuses DSI, cette approche progressive apporte déjà un gain significatif, sans nécessiter la mise en place immédiate d’un orchestrateur complet.

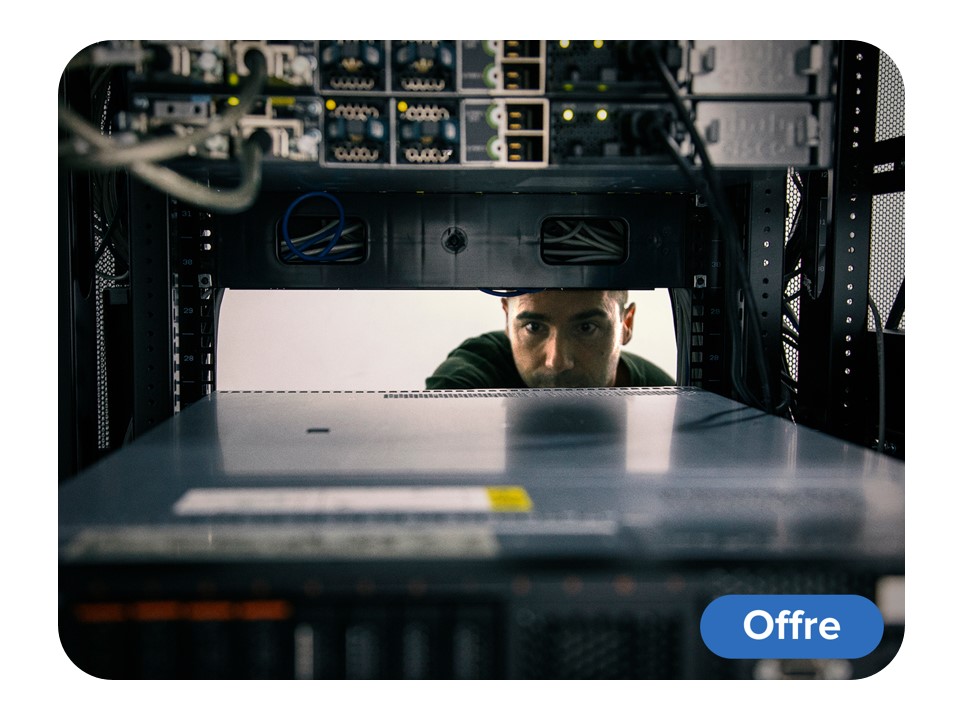

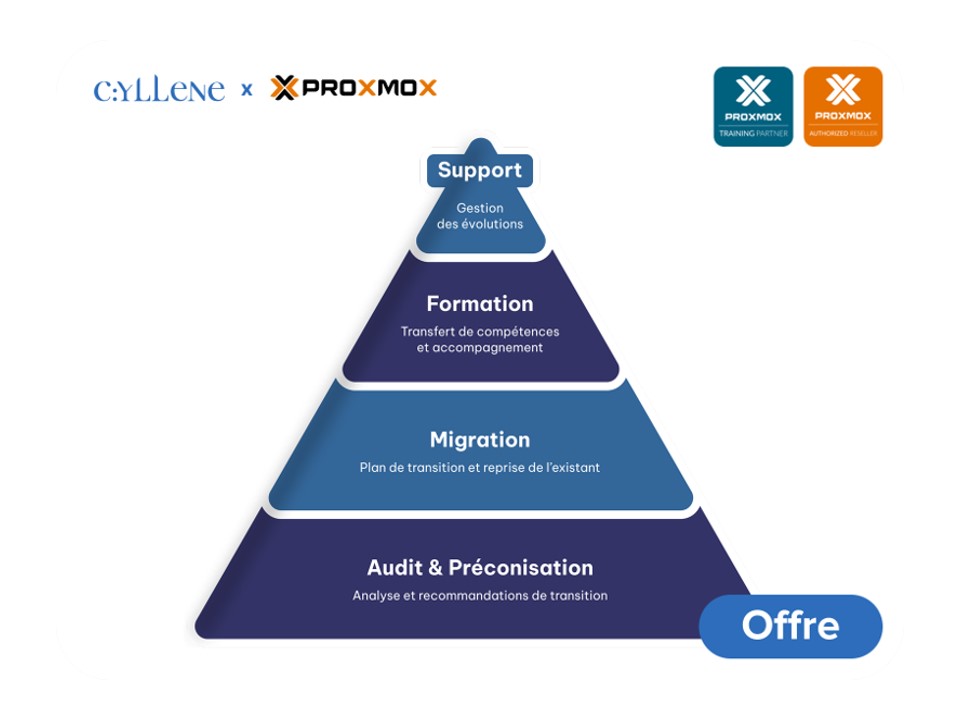

Virtualisation optimisée : renforcer ce qui fonctionne déjà

La modernisation ne signifie pas systématiquement transformer toute l’infrastructure. Les environnements virtualisés actuels, qu’ils reposent sur Proxmox, VMware ou KVM, proposent des capacités avancées de haute disponibilité, de gestion des ressources et d’automatisation, pouvant coexister ou s’intégrer progressivement avec Kubernetes.

Les axes d’amélioration possibles :

- Automatisation du provisioning via Terraform, Ansible ou similaires.

- Normalisation des images, des configurations et des règles de sécurité.

- Centralisation de la supervision et des métriques.

- Rationalisation des machines virtuelles pour réduire la dette technique.

Pour certains environnements, renforcer la virtualisation existante constitue une étape logique, cohérente et durable de la trajectoire de modernisation.

Orchestrateurs légers : progresser sans transformer brutalement

Entre des environnements conteneurisés simples et les orchestrateurs avancés comme Kubernetes, il existe des solutions légères. Ces technologies permettent d’adopter des pratiques modernes – déploiement déclaratif, gestion simplifiée des services, montée en charge maîtrisée – tout en conservant une architecture compréhensible et compatible avec les compétences actuelles des équipes.

Pourquoi envisager cette étape intermédiaire ?

- Installation rapide et maintenance réduite.

- Exigences opérationnelles limitées.

- Possibilité de commencer à automatiser et standardiser les services.

- Idéal pour débuter sur des périmètres contrôlés ou non critiques.

Ces outils constituent un pont vers des pratiques cloud-native sans imposer une rupture immédiate.

Plateformes PaaS : moderniser en délégant une partie de la complexité

Les plateformes PaaS (Platform as a Service) permettent de moderniser les applications sans gérer directement l’infrastructure sous-jacente, souvent en s’appuyant sur Kubernetes en arrière-plan. Des solutions facilitent la gestion du cycle de vie applicatif, la scalabilité et la résilience.

Avantages clés :

- Réduction de la charge opérationnelle.

- Déploiements standardisés et rapides.

- Accès aux services managés du cloud.

- Amélioration du time-to-market.

Pour certaines organisations, le PaaS devient un accélérateur majeur de modernisation, notamment pour les applications web ou les services publics exposés.

Une approche progressive vers le cloud-native

Pour les DSI souhaitant évoluer vers un modèle cloud-native, l’essentiel est la maîtrise du rythme, notamment dans l’adoption de Kubernetes. Une transformation réussie repose sur une succession d’étapes cohérentes plutôt que sur un basculement massif.

Une trajectoire progressive peut inclure :

- La modernisation de la CI/CD (intégration et distribution ou déploiement continus) avant toute refonte profonde.

- La conteneurisation ciblée des applications candidates.

- L’amélioration de l’observabilité, indispensable à toute montée en maturité.

- La standardisation des environnements, qu’ils soient virtualisés ou conteneurisés.

- L’introduction d’orchestrateurs ou de services managés, selon le besoin et le moment opportun.

Cette méthode permet de limiter les risques, de monter en compétences et de préparer sereinement les transitions futures.

Moderniser sans surcomplexifier : les bonnes pratiques pour les DSI

La modernisation du SI doit répondre à un objectif simple : apporter de la valeur au métier tout en garantissant la résilience opérationnelle. Pour éviter les projets surdimensionnés ou les ruptures techniques, plusieurs principes forts émergent.

1. Aligner la modernisation sur les besoins réels

Les choix technologiques doivent être dictés par la criticité, l’usage, la durée de vie et la valeur métier des applications.

2. Favoriser la simplicité opérationnelle

Les solutions adoptées doivent être maîtrisables par les équipes, sans dépendre de compétences rares ou difficiles à maintenir.

3. Automatiser avant de transformer

Une infrastructure automatisée réduit les risques et fluidifie toute évolution ultérieure.

4. Accompagner les équipes dans la montée en compétences

La modernisation technique n’a de sens que si les collaborateurs peuvent l’exploiter efficacement.

5. Élaborer une trajectoire plutôt qu’une rupture

L’objectif est la cohérence, pas la vitesse. Une trajectoire pensée, documentée et progressive produit des résultats plus durables.

Conclusion : construire une trajectoire adaptée à votre SI

Les DSI doivent suivre une démarche progressive, rationnelle, alignée avec leurs besoins opérationnels et leurs ressources. Moderniser un SI est un processus global qui peut s’appuyer sur de multiples leviers : conteneurisation, virtualisation avancée, automatisation, PaaS, orchestrateurs légers ou services managés.

L’essentiel est de définir ensemble une trajectoire réaliste, adaptée à votre contexte, et capable d’accompagner votre organisation vers des architectures plus modulaires, plus résilientes et plus agiles — au bon rythme, avec les bons outils, les bonnes compétences, un intégrateur expert et selon vos priorités.

- Découvrez nos autres visions d’experts :

- Sauvegarde OnPrem ou managée : quel est le véritable coût ?

- Cyllene franchit le Jalon O et engage officiellement son offre IaaS sur la trajectoire de la qualification SecNumCloud.

- Kamino bouscule les standards de la gestion de données avec une plateforme souveraine, performante et hybride.